El hospital universitario de Utrecht (Holanda) abrió hoy una investigación médica tras revelarse que al menos 26 mujeres podrían haber sido inseminadas con el esperma erróneo durante el proceso de fecundación in vitro (FIV) al que fueron sometidas.

En un comunicado, el centro médico reconoce la existencia de estos fallos y explica que tuvieron lugar entre mediados de abril de 2015 y mediados del pasado mes de noviembre.

Según el hospital, se trata de «un error de procedimiento en el laboratorio» de las FIV.

«Por dicho error, la fecundación de los óvulos de 26 mujeres podría haber sido con el espermatozoide de otro hombre que no es el padre previsto», explicó.

Sin embargo, advierte de que «la posibilidad de que esto haya ocurrido es pequeña, pero no puede descartarse», por lo que abre una investigación con todos los afectados.

La mitad de las mujeres en cuestión han dado ya a luz o han logrado quedarse embarazadas.

Además, hay trece embriones congelados como parte de este tratamiento, que corresponde a la otra mitad de las parejas afectadas por el error.

El hospital asegura haberse puesto en contacto con las parejas y haber remitido todos los informes a la inspección de Sanidad.

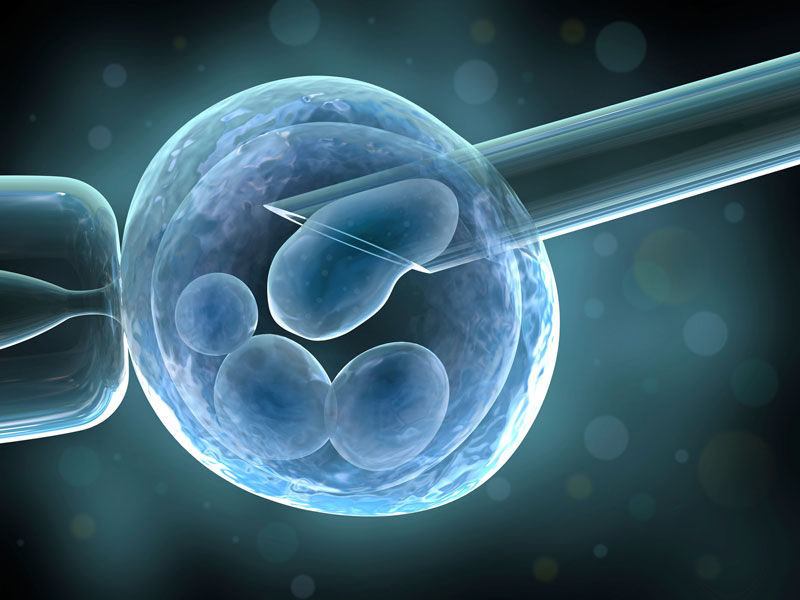

Este proceso de FIV consiste en la inyección directa de una célula espermática en el ovocito y es en ese proceso donde se habría cometido la mezcla de espermatozoides.

El error se habría producido al utilizar la misma herramienta ya usada en otro tratamiento anterior con otra pareja.

Al darse cuenta de ello, el hospital asegura que ha detenido de inmediato todos los procesos de FIV que corresponden a ese periodo de tiempo.

En la nota, el centro médico también promete «minimizar» las consecuencias de este error para todas las parejas, así como clarificar lo ocurrido lo antes posible.

Las parejas que ya hayan tenido al bebé podrán someterse a una prueba de ADN para comprobar que no fueron víctimas de lo que le hospital califica de «error humano».

Mientras, las que aún estén en proceso, el hospital les da la opción de comenzar todo el tratamiento desde el principio.

Noticias MVS

Méxicohace 2 días

Méxicohace 2 días

Chihuahuahace 2 días

Chihuahuahace 2 días

Chihuahuahace 15 horas

Chihuahuahace 15 horas

Policiacahace 20 horas

Policiacahace 20 horas